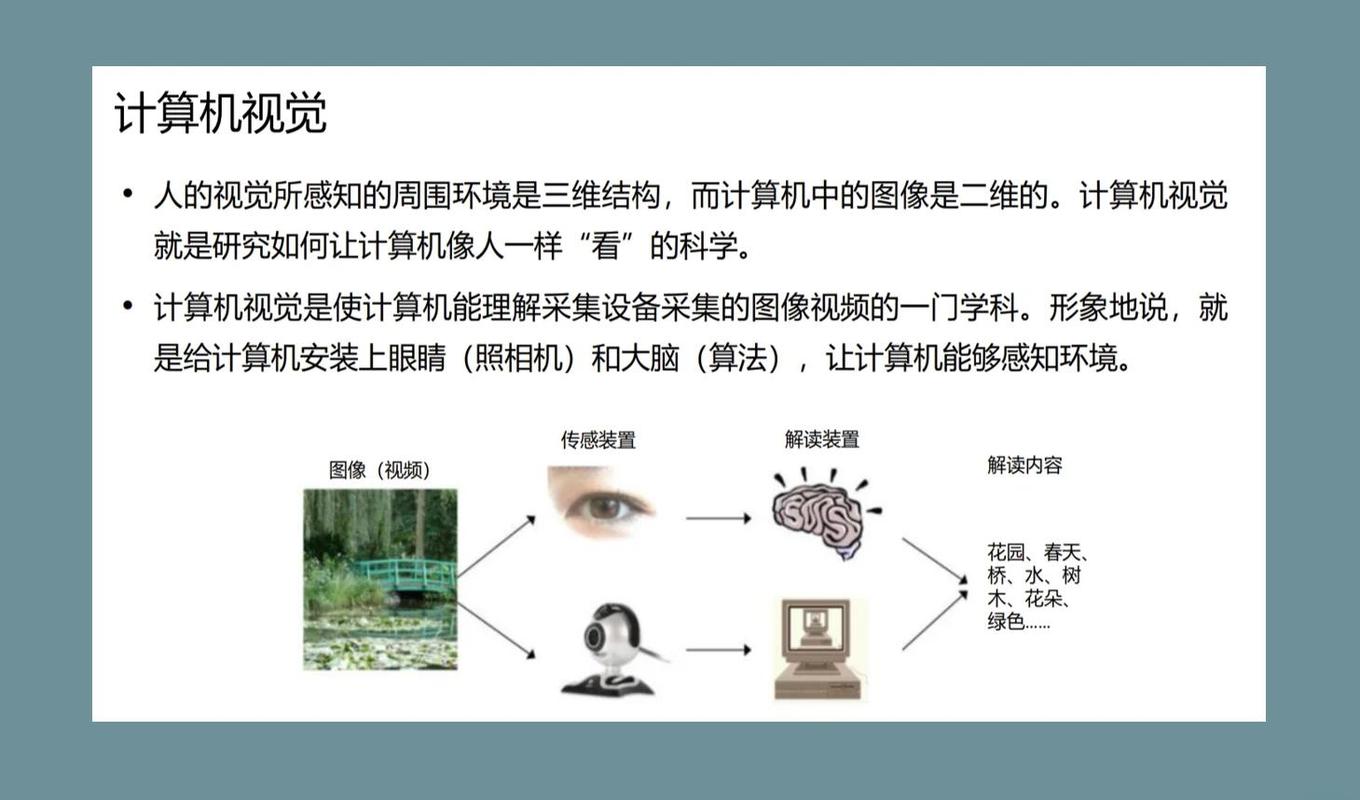

人工智能视觉领域的计算机视觉第21章 OpenCV轻量级部署技术

第二十一章 轻量化部署技术

@TOC

前言: 轻量化部署技术

学习目标:掌握将 视觉算法和深度学习模型部署到树莓派、 手机等资源受限设备的核心方法,实现离线、低功耗、实时的边缘视觉应用。

1. 通俗理解:为什么需要“轻量化部署”?

场景

云端方案问题

边缘部署优势

智能门锁人脸解锁

需联网 → 延迟高、隐私泄露

本地运行 → 快速响应、数据不出设备

工厂质检摄像头

上传视频 → 带宽成本高

终端处理 → 只传结果,省流量

户外无人机巡检

无网络覆盖

完全离线 → 无网也能工作

轻量化 = 模型小 + 速度快 + 功耗低

目标设备:树莓派(1~4GB RAM)、 手机、 Nano关键约束:CPU 性能弱、内存小、电池供电

2. 轻量化核心技术全景图

graph LR

A[原始模型/算法] --> B{优化方向}

B --> C1[模型压缩]

B --> C2[算法简化]

B --> C3[硬件加速]

C1 --> D1[量化: FP32→INT8]

C1 --> D2[剪枝: 移除冗余层]

C1 --> D3[知识蒸馏: 大模型→小模型]

C2 --> D4[降低输入分辨率]

C2 --> D5[替换复杂算子]

C2 --> D6[跳帧处理]

C3 --> D7[TensorRT GPU加速]

C3 --> D8[OpenCV with NEON/VFP]

C3 --> D9[Android NNAPI]

D1 & D2 & D3 & D4 & D5 & D6 & D7 & D8 & D9 --> E[部署到终端]

E --> F1[树莓派]

E --> F2[Android]

E --> F3[单片机+摄像头模块]3. 实战一:树莓派 + 人脸解锁系统 硬件准备 软件环境配置

# 1. 安装 OpenCV(带优化)

sudo apt update

sudo apt install python3-opencv libatlas-base-dev libhdf5-dev

# 2. 验证 NEON 加速(ARM SIMD 指令集)

python3 -c "import cv2; print(cv2.getBuildInformation())"

# 查看是否包含:NEON = YES, VFPV3 = YES代码实现(轻量级 Haar 人脸检测)

# face_unlock_rpi.py

import cv2

import time

import RPi.GPIO as GPIO

# 初始化 GPIO(模拟开锁信号)

LOCK_PIN = 18

GPIO.setmode(GPIO.BCM)

GPIO.setup(LOCK_PIN, GPIO.OUT)

GPIO.output(LOCK_PIN, GPIO.LOW)

class LightweightFaceUnlock:

def __init__(self):

# 使用轻量级 Haar 分类器

self.face_cascade = cv2.CascadeClassifier(

'/usr/share/opencv4/haarcascades/haarcascade_frontalface_default.xml'

)

self.cap = cv2.VideoCapture(0)

self.cap.set(cv2.CAP_PROP_FRAME_WIDTH, 320) # 降低分辨率

self.cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 240)

self.cap.set(cv2.CAP_PROP_FPS, 15) # 限制帧率

# 已注册人脸特征(实际项目中应存储多个人脸)

self.registered_face = None

def detect_face(self, frame):

"""轻量级人脸检测"""

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 关键参数调优:牺牲精度换速度

faces = self.face_cascade.detectMultiScale(

gray,

scaleFactor=1.3, # 增大步长

minNeighbors=4, # 减少验证次数

minSize=(40, 40), # 过滤小脸

flags=cv2.CASCADE_SCALE_IMAGE

)

return faces

def unlock_door(self):

"""模拟开锁动作"""

print(" 人脸匹配!正在开锁...")

GPIO.output(LOCK_PIN, GPIO.HIGH)

time.sleep(2) # 开锁保持2秒

GPIO.output(LOCK_PIN, GPIO.LOW)

print(" 门已关闭")

def run(self):

print(" 启动人脸解锁系统(按 'q' 退出)")

last_unlock_time = 0

while True:

ret, frame = self.cap.read()

if not ret:

break

start_time = time.time()

faces = self.detect_face(frame)

fps = 1.0 / (time.time() - start_time)

# 绘制检测框

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (0, 255, 0), 2)

# 简单解锁逻辑:检测到人脸即开锁(实际需人脸识别)

current_time = time.time()

if current_time - last_unlock_time > 5: # 防止重复触发

self.unlock_door()

last_unlock_time = current_time

# 显示状态

cv2.putText(frame, f"FPS: {fps:.1f}", (10, 20),

cv2.FONT_HERSHEY_SIMPLEX, 0.6, (255, 255, 255), 1)

cv2.imshow('Face Unlock - Raspberry Pi', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

self.cap.release()

cv2.destroyAllWindows()

GPIO.cleanup()

if __name__ == "__main__":

system = LightweightFaceUnlock()

system.run()树莓派优化技巧:

分辨率降至 320×240(速度提升 3 倍)使用 标志加速限制 FPS 避免 CPU 过载

4. 实战二: 端 实时滤镜 开发环境 项目结构

app/

├── src/main/java/com/example/opencvfilter/

│ ├── MainActivity.java

│ └── CameraView.java

├── src/main/cpp/

│ └── native-lib.cpp # C++ 滤镜实现

└── libs/armeabi-v7a/

└── libopencv_java4.soJava 层(.java)

// MainActivity.java

public class MainActivity extends AppCompatActivity {

private CameraView cameraView;

private BaseLoaderCallback loaderCallback = new BaseLoaderCallback(this) {

@Override

public void onManagerConnected(int status) {

if (status == LoaderCallbackInterface.SUCCESS) {

cameraView.enableView();

}

}

};

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

cameraView = findViewById(R.id.camera_view);

cameraView.setCvCameraViewListener(new CvCameraViewListener2() {

@Override

public void onCameraViewStarted(int width, int height) {}

@Override

public void onCameraViewStopped() {}

@Override

public Mat onCameraFrame(CvCameraViewFrame inputFrame) {

Mat rgba = inputFrame.rgba();

// 调用 native 方法

applyCartoonFilter(rgba.getNativeObjAddr());

return rgba;

}

});

}

@Override

protected void onResume() {

super.onResume();

OpenCVLoader.initAsync(OpenCVLoader.OPENCV_VERSION, this, loaderCallback);

}

// JNI 声明

public native void applyCartoonFilter(long matAddrRgba);

}C++ 层(-lib.cpp)— 轻量级卡通滤镜

// native-lib.cpp

#include

#include

using namespace cv;

extern "C" JNIEXPORT void JNICALL

Java_com_example_opencvfilter_MainActivity_applyCartoonFilter(JNIEnv *, jobject, jlong addrRgba) {

Mat& rgba = *(Mat*)addrRgba;

Mat img;

cvtColor(rgba, img, COLOR_RGBA2BGR);

// 步骤1: 降低颜色数(K-means 聚类太重 → 改用双边滤波+颜色量化)

Mat reduced;

bilateralFilter(img, reduced, 9, 75, 75); // 保边平滑

// 步骤2: 边缘检测(用轻量级 Laplacian 替代 Canny)

Mat edges;

Laplacian(reduced, edges, CV_8U, ksize=5);

threshold(edges, edges, 50, 255, THRESH_BINARY_INV);

// 步骤3: 合并

Mat cartoon;

bitwise_and(reduced, reduced, cartoon, edges);

cvtColor(cartoon, rgba, COLOR_BGR2RGBA);

} 优化技巧:

使用 替代 K-means(速度提升 5 倍)用 替代 Canny(减少 2 次高斯模糊)JNI 直接操作 Mat 内存,避免拷贝

5. 模型轻量化实战: + 加速 YOLO 环境要求 转换 ONNX 到 引擎

# build_engine.py

import tensorrt as trt

def build_engine(onnx_file, engine_file):

logger = trt.Logger(trt.Logger.WARNING)

builder = trt.Builder(logger)

network = builder.create_network(1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH))

parser = trt.OnnxParser(network, logger)

with open(onnx_file, 'rb') as model:

parser.parse(model.read())

config = builder.create_builder_config()

config.max_workspace_size = 1 << 30 # 1GB

config.set_flag(trt.BuilderFlag.FP16) # 启用半精度

profile = builder.create_optimization_profile()

profile.set_shape("input", (1, 3, 320, 320), (1, 3, 640, 640), (1, 3, 640, 640))

config.add_optimization_profile(profile)

engine = builder.build_serialized_network(network, config)

with open(engine_file, "wb") as f:

f.write(engine)

if __name__ == "__main__":

build_engine("yolov8n.onnx", "yolov8n.engine")在 中使用 引擎

# infer_trt.py

import tensorrt as trt

import pycuda.driver as cuda

import pycuda.autoinit

import numpy as np

import cv2

class TRTYOLODetector:

def __init__(self, engine_path):

with open(engine_path, "rb") as f:

runtime = trt.Runtime(trt.Logger(trt.Logger.WARNING))

self.engine = runtime.deserialize_cuda_engine(f.read())

self.context = self.engine.create_execution_context()

self.inputs, self.outputs, self.bindings, self.stream = allocate_buffers(self.engine)

def detect(self, image):

# 预处理(同前)

blob = cv2.dnn.blobFromImage(image, 1/255.0, (640, 640), swapRB=True)

np.copyto(self.inputs[0].host, blob.ravel())

# TensorRT 推理

[cuda.memcpy_htod_async(inp.device, inp.host, self.stream) for inp in self.inputs]

self.context.execute_async_v2(bindings=self.bindings, stream_handle=self.stream.handle)

[cuda.memcpy_dtoh_async(out.host, out.device, self.stream) for out in self.outputs]

self.stream.synchronize()

return self.outputs[0].host

# 辅助函数(略,参考 NVIDIA 官方示例)性能对比( Nano):

| 模型 | -DNN (FP32) | (FP16) |

|------|------------------|----------------|

| | 8 FPS | 18 FPS |

| 模型大小 | 6.2 MB | 3.1 MB |

6. 边缘计算适配策略 策略 1:算法简化四原则降分辨率:640×480 → 320×240(速度↑4倍,精度↓10%)跳帧处理:每 3 帧处理 1 帧(CPU 占用↓60%)ROI 限定:只处理画面中心区域(如人脸解锁只需上半屏)简化后处理:用 替代 Canny,用 替代 策略 2:硬件适配清单

设备

优化重点

编译选项

树莓派

NEON 指令集

-D =ON

ARM

NNAPI 加速

使用

dnn::Net::(

)

+ CUDA

-D =ON -D =ON

7. 应用场景落地指南 智能家居 工业检测 便携设备 本章总结

技术方向

关键工具

性能收益

模型压缩

,

体积↓50%,速度↑2~3倍

算法简化

降分辨率 + 跳帧

CPU 占用↓60%

硬件加速

NEON, CUDA, NNAPI

利用专用指令集

嵌入式部署

树莓派/ SDK

实现离线运行

现在可以:

将你的 项目部署到树莓派做成智能家居设备开发 手机上的实时 AI 滤镜 App为企业提供低成本工业视觉解决方案!

资料关注